Lograr que las máquinas se adapten mejor a la naturaleza imperfecta de la planificación humana y que ayuden a corregir nuestros errores es uno de los objetivos centrales de la Inteligencia Artificial. Ahora, un nuevo algoritmo desarrollado por científicos del Instituto Tecnológico de Massachusetts (MIT) logra inferir objetivos y planes, incluso cuando los mismos pueden fallar.

De acuerdo a una nota de prensa, el nuevo algoritmo creado por los especialistas del MIT busca adaptar la inteligencia social humana al mundo de las máquinas, generando esquemas que logren entender nuestros errores para intentar subsanarlos. Esto podría optimizar las prestaciones de robots y otros dispositivos de asistencia. Los resultados de la investigación fueron publicados recientemente en el repositorio arXiv.

Una gran limitación de los sistemas de Inteligencia Artificial es su falta de conexión con ciertos aspectos del comportamiento humano. La ausencia de empatía y de sentido común va mucho más allá de la carencia de un plano emotivo: tiene que ver con la aceptación del error, una característica básica que nos define como humanos y que las máquinas directamente no conciben entre sus posibilidades.

De esta forma, si el objetivo es desarrollar esquemas de Inteligencia Artificial que puedan dotar a robots sociales o asistentes virtuales de las condiciones necesarias para crear lazos profundos con el ser humano y solucionar sus problemas, es crucial que las máquinas comprendan que el error es un elemento ineludible de nuestro accionar. Bajo esta perspectiva, podrán considerarlo dentro de sus posibilidades y ayudarnos a corregir el camino en vez de potenciar el rumbo equivocado.

Errar es humano

«La capacidad para advertir los errores humanos podría ser crucial para construir máquinas que infieran y actúen de manera sólida con nuestros intereses. Los algoritmos del futuro tendrán que reconocer nuestras equivocaciones, malos hábitos e irracionalidades, ayudándonos a evitarlos en lugar de reforzarlos», indicó Tan Zhi-Xuan, estudiante de doctorado del MIT y autor principal de la investigación.

La gran ventaja del nuevo algoritmo creado por los investigadores del MIT es que tiene en cuenta los errores al momento de inferir objetivos y planes. Comprende la tendencia humana a dejar aspectos atados a la improvisación, incorporando todos estos factores al momento de diseñar sus predicciones. Teniendo en cuenta esta característica, es capaz de conectar más fácilmente con nuestras necesidades.

El modelo fue creado en base a la plataforma Gen, una nueva herramienta de programación en Inteligencia Artificial desarrollada recientemente en el MIT. La estructura de trabajo integra la planificación simbólica con la inferencia bayesiana, una técnica ideal al momento de combinar las creencias y la incertidumbre con los nuevos datos de la realidad. Dadas sus ventajas, se emplea habitualmente en la evaluación de riesgos financieros y en el ámbito de los estudios de opinión pública.

Paso a paso

Cuando se puso a prueba, el nuevo algoritmo alcanzó excelentes resultados. Funcionó de 20 a 150 veces más rápido que otros métodos, como por ejemplo el Aprendizaje por refuerzo inverso bayesiano (BIRL), un modelo que observa comportamientos e intenta diseñar estrategias a futuro. Además, al momento de inferir objetivos el nuevo algoritmo alcanzó una efectividad del 75 por ciento.

El nuevo esquema, denominado Búsqueda secuencial inversa de planes (SIPS), trabaja únicamente en base a planes parciales en cada paso y elimina planes poco probables desde un primer momento. Este modelo "paso a paso" permite ir detectando errores en cada secuencia del plan para poder corregirlos, algo que sería imposible con una planificación fija y rigurosa a largo plazo.

Referencia

Online Bayesian Goal Inference for Boundedly-Rational Planning Agents. Tan Zhi-Xuan, Jordyn L. Mann, Tom Silver, Joshua B. Tenenbaum, Vikash K. Mansinghka. arXiv (2020).

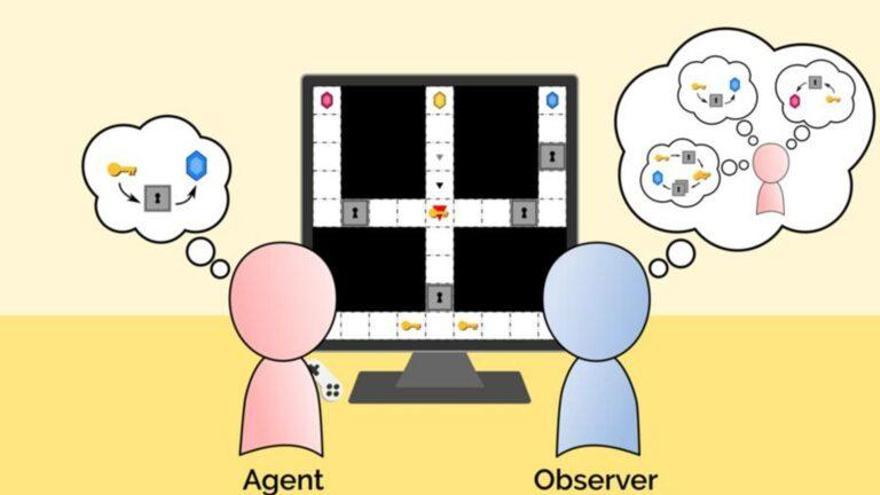

Imagen:

Un «agente» y un «observador» demuestran cómo un nuevo algoritmo es capaz de inferir objetivos y planes, incluso cuando esos planes pueden fallar. Crédito: Tan Zhi-Xuan et al.